管理職の約4割に発生する「避けられない業務ニーズ」星のまなびカフェ(https://every-day-is-a-new-day.com/)調査で判明

GRASグループ株式会社が運営する、女性のキャリアを応援するメディア「星のまなびカフェ」は、生成AIを業務で利用している会社員478名を対象に「生成AIの活用実態に関する匿名意識調査」を実施いたしました。

■ 調査の背景

生成AIの急速な普及により、多くの企業で業務効率化が進む一方で、企業が許可・把握していない個人の生成AIアカウントを業務で利用する「シャドーAI」のリスクが懸念されています。本調査は、綺麗事では語れない「現場のリアルなAI利用実態」と「隠れたセキュリティリスク」を浮き彫りにし、企業が取るべき真の対策を明らかにする目的で実施されました。

■ トピックス

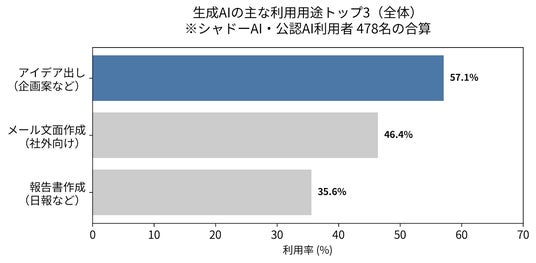

【基本実態】 全体で最も使われている用途は「アイデア出し(57%)」と「メール作成(46%)」。日常業務への定着が進行。

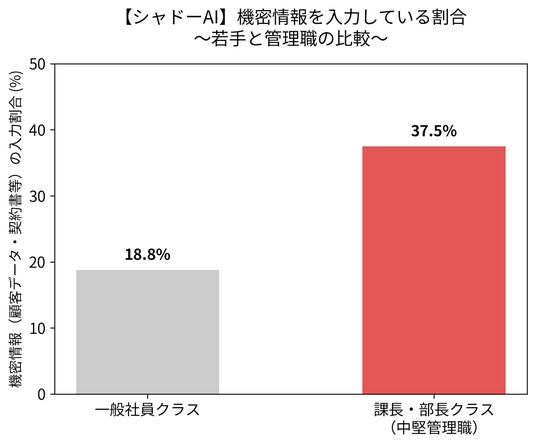

【リスクの核心】 シャドーAIに「顧客データ」「契約書」を入力する割合は、一般社員(18%)より課長・部長クラス(37%)の方が約2倍高い。

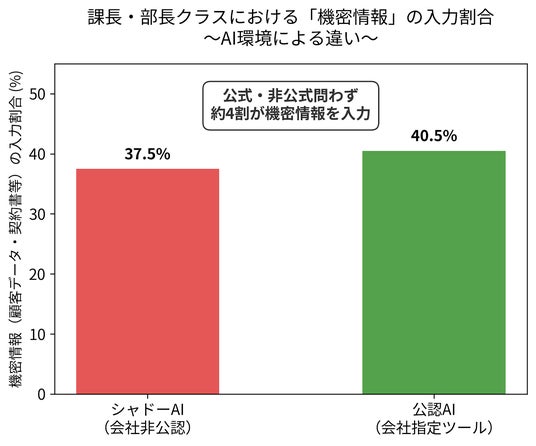

【ルールの限界】 公式・非公式問わず、管理職の約4割がAIに機密情報を入力。

【調査概要】

調査名称:生成AIの活用実態に関する匿名意識調査

調査期間:2026年4月

調査対象:生成AIを業務で利用している会社員

有効回答数:478名(シャドーAI利用者 251名、公認AIのみ利用者 227名*)

調査方法:インターネット調査(無記名式)

※注記:本調査における「シャドーAI利用者」と「公認AIのみ利用者」は、それぞれの条件を指定して別々にアンケート募集を行ったものです。そのため、上記の有効回答数の内訳は、世の中の生成AI利用者全体におけるシャドーAIの利用割合(発生率)を示すものではありません。

【引用について】

本記事のデータ・画像・文章を引用する際には必ず元記事である「星のまなびカフェ」からの引用である旨をリンクつきで併記してください。

(例)引用元:星のまなびカフェ「シャドーAIに「機密情報」を入力する割合、“課長・部長クラス”において一般社員の約2倍にのぼる」

1. 【基本実態】日常業務に浸透する生成AI。トップ用途は「アイデア出し」「メール」

生成AIを業務で利用している回答者全体に「どのような用途で利用しているか(複数選択)」を聞いたところ、トップは「企画案やネーミングなどのアイデア出し(57.1%)」、次いで「外部とのメールの文面作成(46.4%)」「日報や研修レポートなどの報告書作成(35.5%)」となりました。 この結果から、生成AIが日常的なテキスト業務の効率化に広く定着していることが伺えます。

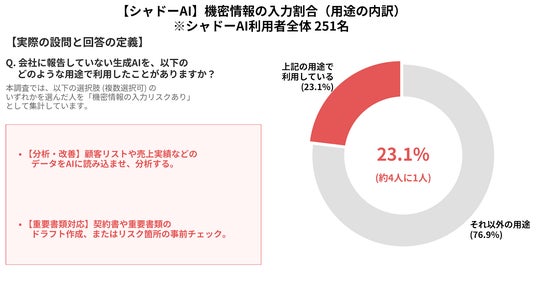

2. シャドーAI利用者の「約4人に1人」が機密情報を入力

しかし、日常業務への定着が進む裏で、深刻なセキュリティリスクが顕在化しています。 会社に報告せず個人の生成AIアカウント等を利用している「シャドーAIユーザー(251名)」に対し、具体的にどのようなデータを入力しているか調査したところ、全体の23.1%(約4人に1人)が「顧客リストや売上実績」「契約書などの重要書類」といった機密性の高い情報を入力していることが分かりました。

3. 若手より危険? 管理職の「約4割」が機密情報を入力している事実

さらにこの実態を役職別に分析したところ、予想外の事実が浮き彫りになりました。機密情報を入力している割合は、一般社員クラスが18.8%であったのに対し、課長・部長クラスの中堅管理職では「37.5%(約2倍)」に跳ね上がる結果となりました。 決裁権や重要データを扱う権限を持つであろう管理職ほど、この傾向が強まるデータとなりました。

より重要なデータを扱う機会自体が増えることや、会社のルールに対して一般社員クラスよりも危機感を覚えにくいことが仮説としてあげられますが、この点については追加での調査が必要となりそうです。

4. 重要な情報をAIに処理させること自体にニーズがある

では、「機密情報のAI入力は禁止」とルールを厳格化するだけで、シャドーAI問題は解決するのでしょうか?

その答えを紐解くため、本調査ではあえて「会社から安全な公認AIを与えられている層」の利用実態も比較分析しました。結果として、公認AIを利用している管理職の40.5%が、業務の一環として機密情報をAIに入力していることが分かりました。

もちろん、入力データが学習に利用されない法人向けの「公認AI」で会社が許可しているのであれば、機密情報を入力してもセキュリティ上の問題はありません。この比較データがもたらす重要な仮説は、「機密データをAIで処理し、高度な業務効率化を図ること」が、もはや管理職にとって欠かせない業務ニーズになっているということです。

つまり、安全に機密を扱える「公認AI(正当な受け皿)」を与えずに、ただルールで禁止するだけでは、根本的なニーズは消えません。結果として、効率化を求める管理職がルールの目を盗み、監視のない『個人のシャドーAI』という危険な抜け道へ機密情報が流出してしまうのが現実です。

5. 【真のリスク】シャドーAIの本当の恐怖は、情報漏洩ではなく「契約違反(NDA)による信用失墜」

「個人の無料AIにデータを入れても、それが直接他社に漏れる確率は低い」と考えるビジネスパーソンは少なくありません。しかし、シャドーAIの本当のリスクは物理的な情報流出ではありません。

実は、国(政府)もこの危険性に警鐘を鳴らしています。総務省が周知した『ChatGPT等の生成AIの業務利用に関する申合せ(令和5年5月8日)』では、無料版のChatGPTのようなサービスを「約款型外部サービス」と定義し、「セキュリティ要件を満たすことが困難であることから、原則として機密情報を取り扱うことはできない」と明言しています。さらに、組織の承認を得ずに利用する「シャドーIT」は、管理を不可能にし、情報漏洩等のリスクを決定的に高めると厳しく指摘しています。

つまり、企業が把握・管理していない外部サーバーに「顧客データ」や「契約書」を送信する行為そのものが、国のセキュリティ基準にも反する明らかなコンプライアンス違反(取引先とのNDA違反・個人情報保護法違反)に直結するのです。

無料AIには入力データをAIの学習に利用するリスク(目的外利用)があり、万が一取引先に発覚した場合、「実際には漏洩していません」という個人の言い訳は一切通用せず、企業としてのガバナンスが問われ、取引停止などの致命的なダメージを負うことになりかねません。

■ 総括/企業に求められる「言い訳の利く、安全な受け皿」の整備

管理職がAIに機密情報を処理させることは、もはや後戻りできない不可逆の業務フローになりつつあります。企業は、「ルールで禁止する」という思考停止をやめなければなりません。

シャドーAIによる致命的なNDA違反を防ぐ唯一の解決策は、入力データがAIの学習に利用されず、法的に「適切な業務委託」としてクリアになる『法人向けビジネスアカウント(安全なAI環境)』をいち早く契約し、社員に提供することです。社員が堂々と機密データを処理できる「安全で満足度の高い受け皿」を用意することこそが、今企業に求められる最も確実なセキュリティ対策です。

【本記事に関するお問い合わせフォーム】

星のまなびカフェ運営事務局(GRASグループ株式会社)

・https://every-day-is-a-new-day.com/contact/

【運営会社】 GRASグループ株式会社

・https://gras-group.co.jp/

【運営メディア】

・忍者英会話

・ALL英会話

・EnglishHub

・おうち部

【参考文献・資料】

総務省自治行政局デジタル基盤推進室. "ChatGPT 等の生成AI の業務利用について". 総務省. 2023-05-08. https://www.soumu.go.jp/main_content/000879561.pdf, (参照 2026-04-12).

公式フェイスブックページ

公式フェイスブックページ