~LLMファインチューニング技術を活用~

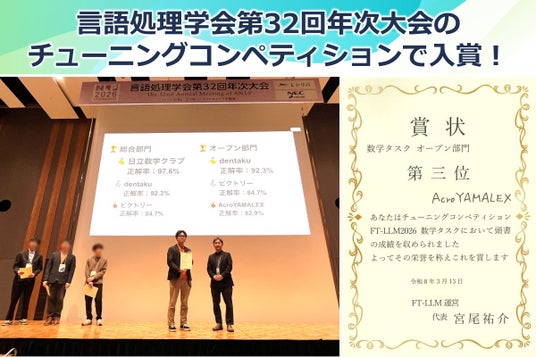

アクロクエストテクノロジー株式会社(本社:神奈川県横浜市・代表取締役:新免流、以下、アクロクエスト)のデータサイエンスチームであるAcroYAMALEX(以下、YAMALEX)は、言語処理学会第32回年次大会(NLP2026)で開催された第2回「大規模言語モデルのファインチューニング技術と評価」ワークショップのチューニングコンペティションにおいて、数学タスク部門 第3位を受賞しました。

■第2回「大規模言語モデルのファインチューニング技術と評価」ワークショップとは

大規模言語モデル(LLM)のファインチューニング技術に関心のある研究者が議論を行うワークショップです。2026年3月に開催された第2回のワークショップでは、ファインチューニング技術を競うコンペティションが実施され、各チームが用いた技術や結果について発表・議論が行われました。

チューニングコンペティションの数学タスクでは、日本の中学校・高等学校で扱う数学問題を対象に、言語モデルを基盤とするシステムを構築してその回答精度を競います。

参加枠は、オープン枠とクローズ枠があり、AcroYAMALEXチームはオープン枠で参加しました。オープン枠では、最終的なシステムをOSSライセンスで公開することが条件となっています。

■YAMALEXチームの結果

当社の最先端技術研究チームである「YAMALEX」は、この大会にチームとして参加し、全24チームが参加する中で、数学タスク部門 第3位を受賞しました。

今回、オープンライセンスのデータセット・モデルのみを用いて、数学問題に回答するモデルを構築しました。AcroYAMALEXチームはLLMを用いた合成データを作成することで高精度なモデルを実現しました。

▼言語処理学会第32回年次大会(NLP2026)

第2回「大規模言語モデルのファインチューニング技術と評価」ワークショップ

チューニングコンペティション

https://llm-jp.github.io/tuning-competition/2026/workshop.html

■参加チーム概要

- チーム名: AcroYAMALEX(アクロヤマレックス)

- メンバー:佐々木 峻、山本 大輝、樋口 慎、吉岡 駿

以下、機械学習エンジニアの佐々木のコメントです。

<佐々木コメント>

今回のオープン枠では、オープンライセンスのモデル・データのみが使用可能というルールでした。この条件では利用可能なデータセットが限られており、モデル構築には多くの工夫が必要でした。ライセンスの制約も含めてモデル開発の難しさを実感でき、非常に貴重な経験となりました。

アクロクエストは、これからもAI/機械学習やデータ分析・解析の技術向上を図り、お客様の課題解決とより良いサービスの創出に努力してまいります。

【参考情報等】

■言語処理学会第32回年次大会(NLP2026)

https://anlp.jp/nlp2026/

■AcroYAMALEXとは

https://www.acroquest.co.jp/business/acro-yamalex/

アクロクエストテクノロジー株式会社

アクロクエストテクノロジー株式会社

アクロクエストテクノロジー株式会社 広報 担当/白井 智子(しろい さとこ)

本件に関するお問い合わせは、以下のメール、またはお問い合わせフォームにてお願いいたします。

〒222-0033 神奈川県横浜市港北区新横浜3-17-2 友泉新横浜ビル 5階

E-MAIL : acropr@acroquest.co.jp

公式フェイスブックページ

公式フェイスブックページ